引言:技术进步下的道德拷问

javascript

2024年,当人工智能在医疗领域创造了一个又一个技术奇迹——从AlphaFold3破解蛋白质结构之谜,到AI设计的药物首次进入临床试验——我们不禁要问:当机器开始参与关乎生死的医疗决策时,我们准备好面对随之而来的伦理挑战了吗?

世界卫生组织(WHO)在2021年发布的《卫生健康领域人工智能伦理与治理》指南中明确警告:虽然AI在改善全球医疗保健方面大有希望,但前提是必须将伦理和人权置于其设计、部署和使用的核心[^1]。

本文将深入剖析AI医疗面临的四大核心伦理困境:算法偏见与健康不公、决策透明度与知情同意、数据隐私与安全边界、责任归属与人机关系重构。这些问题不仅是技术挑战,更是对人类价值观的深刻考验。

一、算法偏见:看不见的歧视链条

1.1 数据中的"原罪"

2019年,《科学》杂志刊登的一项研究震惊了医疗界:美国广泛使用的一款医疗资源分配AI算法存在严重的种族偏见。**该算法将接受额外护理的黑人患者比例定为17.7%,而纠正偏见后,这一比例应达到46.5%**[^2]——意味着数以万计的黑人患者被不公平地排除在关键医疗服务之外。

问题的根源在于:算法的训练数据反映了历史上的系统性歧视。由于黑人患者在美国医疗体系中长期面临不平等待遇,他们在历史数据中的医疗支出普遍较低。AI算法误将"医疗支出"作为"医疗需求"的代理指标,从而将历史偏见编码进了决策逻辑中。

1.2 澳大利亚肝移植算法案例

澳大利亚曾开发一款用于优化肝脏移植匹配的AI算法。然而,该系统在实际应用中却加剧了医疗资源分配的不公:原住民患者获得肝移植的概率显著低于白人患者[^3]。

深入分析发现,算法的评估标准(如社会经济地位、居住地稳定性)无形中对原住民群体构成了系统性歧视。这个案例揭示了一个令人不安的事实:即使算法设计者没有恶意,技术本身也可能成为放大社会不平等的工具。

1.3 偏见的多重来源

医疗AI中的偏见并非单一因素造成,而是贯穿整个生命周期:

数据采集阶段:

- 临床试验参与者缺乏多样性(女性、少数族裔代表性不足)

- 电子病历数据质量在不同医疗机构间差异巨大

- 某些疾病在特定人群中研究严重不足

算法设计阶段:

- 开发团队的认知盲区(缺乏多元文化背景)

- 评估指标的隐性偏见(如用收入水平衡量健康需求)

- 优化目标与伦理目标的错配

应用部署阶段:

- 技术可及性的城乡差异

- 使用者对AI工具的接受度差异

- 反馈机制未能及时纠偏

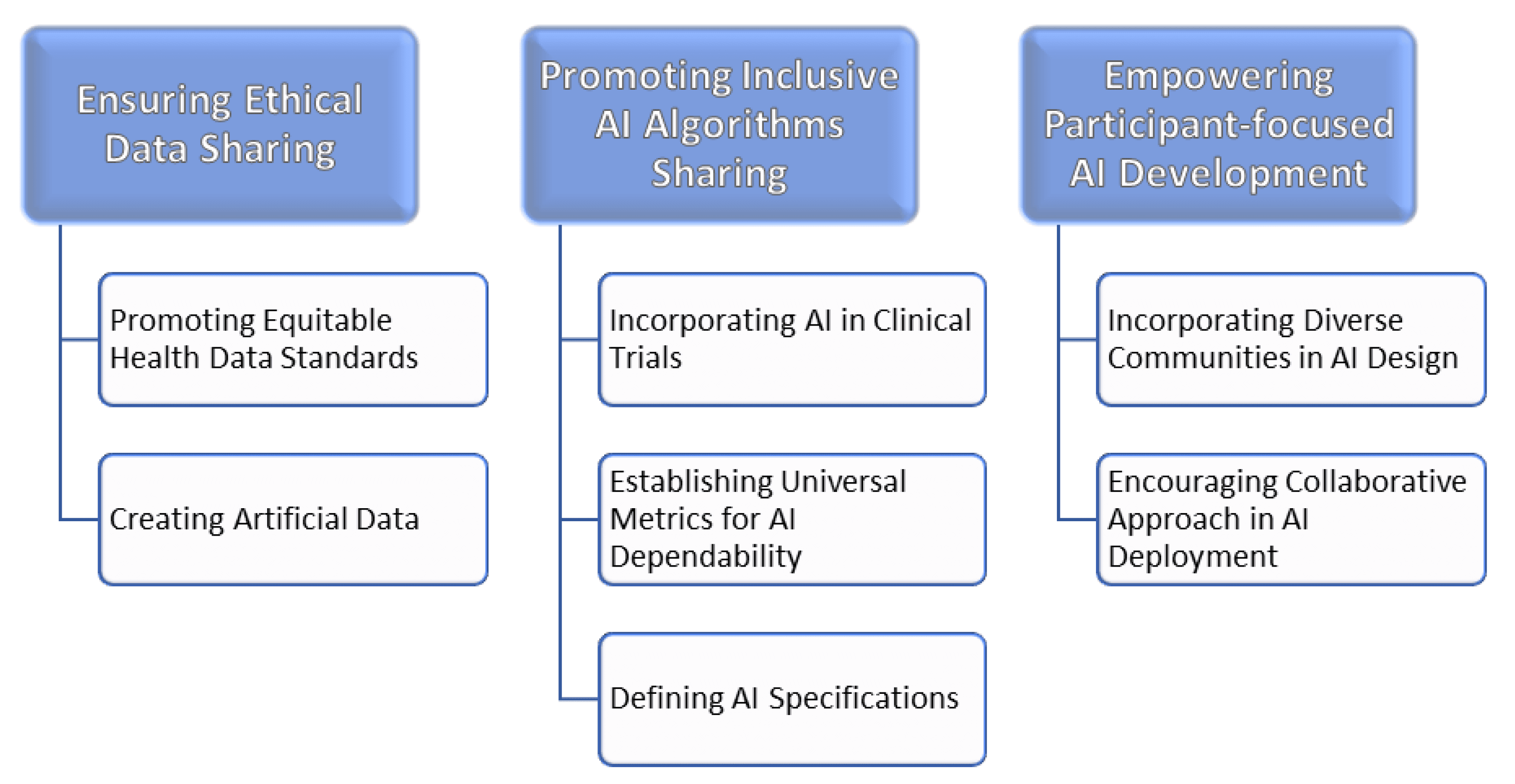

根据《医学与哲学》2024年发表的研究,确保AI训练数据的多样性和代表性,加强对算法的监督和审查,是保障医疗AI公平性的关键[^4]。

二、透明度困境:无法解释的"黑箱"决策

2.1 医生的两难处境

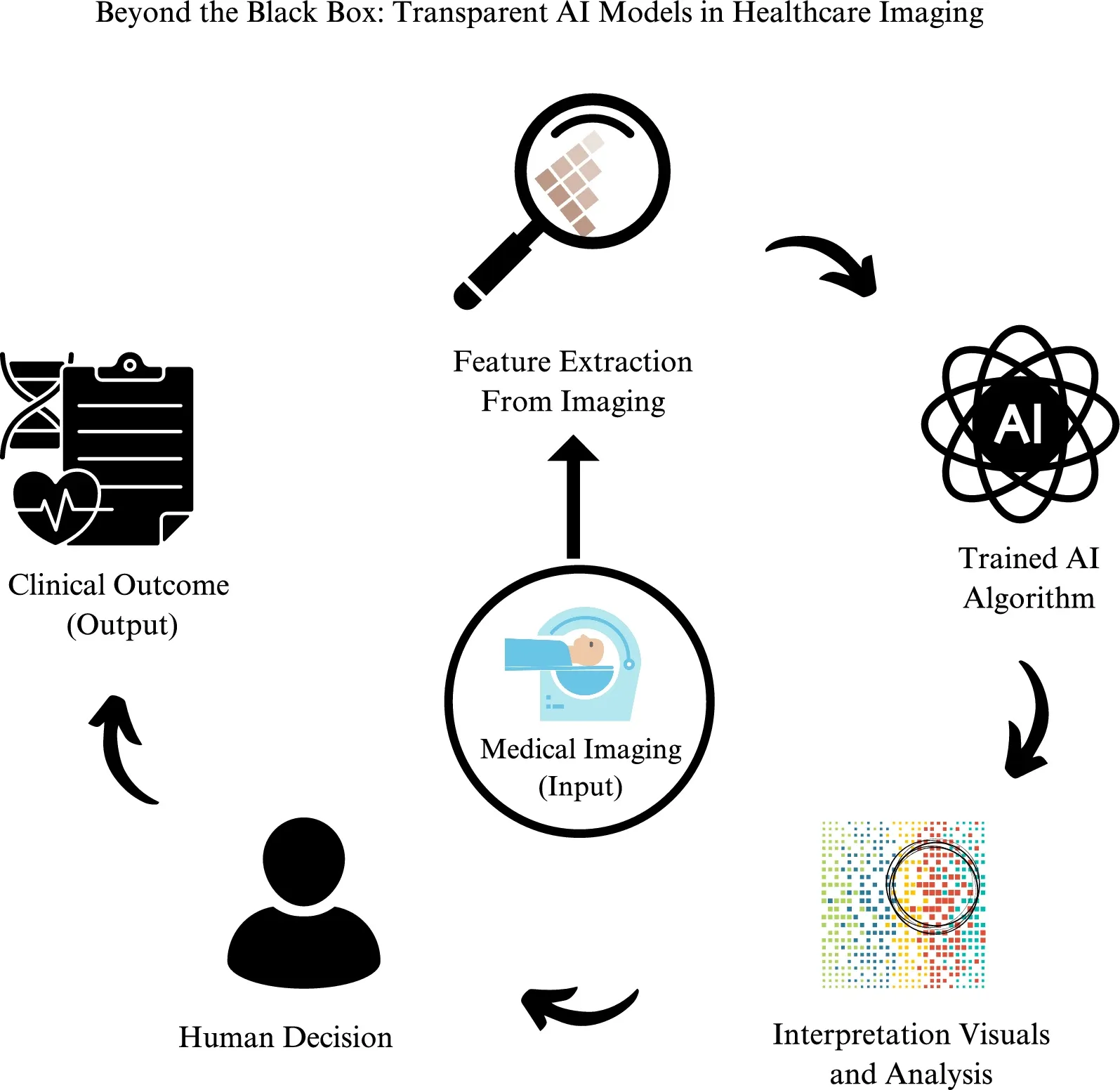

想象这样一个场景:一位医生面对患者询问:"医生,为什么AI建议我做这个手术?"而医生只能回答:"我也不知道AI是如何得出这个结论的,但根据以往经验,它的准确率很高。"

这种情况在现实中并不罕见。深度神经网络的"黑箱"特性使得即使是开发者也难以完全解释模型的决策过程。在涉及生命健康的医疗决策领域,这种不透明性引发了严重的伦理质疑[^5]。

2.2 知情同意权的挑战

传统医疗伦理的核心原则之一是"知情同意"——患者有权了解治疗方案的依据、风险和备选方案。但当AI参与决策时,这一原则面临根本性挑战:

信息不对称加剧:

- 患者难以理解复杂的算法逻辑

- 医生可能也无法充分解释AI的推理过程

- "AI建议"被包装成权威结论,患者缺乏实质性选择权

同意的真实性存疑:

- 患者在不理解AI工作原理的情况下签署的同意书是否有效?

- 如何确保患者不是在信息不充分的情况下被动接受?

WHO在其伦理指南中明确要求:AI技术的透明度必须确保开发人员、用户及监管机构能够理解AI所作出的决定[^1]。

2.3 可解释AI的探索

为应对这一挑战,医学界正在积极发展"可解释人工智能"(Explainable AI, XAI)技术:

技术方法:

- 注意力机制可视化:展示AI在做诊断时重点关注了影像的哪些区域

- 特征重要性分析:量化不同临床指标对决策的贡献度

- 反事实解释:告诉医生"如果某项指标改变,结论会如何变化"

实践困境:

- 解释的准确性与模型性能往往存在权衡

- 过于复杂的解释可能让非专业人士更加困惑

- 恶意行为者可能利用解释信息攻击系统

三、数据隐私:健康信息的"潘多拉魔盒"

3.1 医疗数据的特殊敏感性

医疗数据包含生理指标、病史、基因信息等极度敏感的个人信息,直接关联生命权和隐私权。一旦泄露,后果远超一般数据安全事件:

潜在风险:

- 保险歧视:保险公司根据健康数据拒保或提高保费

- 就业歧视:雇主因员工健康状况拒绝录用或解雇

- 社会污名:某些疾病信息泄露导致社交孤立

- 精准诈骗:不法分子利用健康弱点实施定向欺诈

3.2 全球监管框架的碰撞

不同国家和地区对医疗数据保护的立法存在差异,给跨境AI医疗应用带来合规挑战:

欧盟GDPR:

- 最严格的"知情同意"原则

- 赋予个人"被遗忘权"(要求删除个人数据)

- 违规处罚高达全球营业额的4%或2000万欧元

美国HIPAA:

- 侧重于医疗机构和保险公司的数据保护义务

- 规定数据泄露后的72小时通知机制

- 允许在去标识化后用于研究

中国《个人信息保护法》:

- 将健康信息列为"敏感个人信息"

- 要求单独同意且明确告知处理目的

- 强调数据本地化存储要求

根据研究,AI训练需要大量真实患者数据,但这与日益严格的数据保护法规存在天然张力[^6]。

3.3 隐私保护技术的前沿实践

联邦学习(Federated Learning):

- 数据不出本地,只传输模型参数

- 多家医院协作训练AI而无需共享原始病历

- 挑战:通信开销大、模型收敛慢

差分隐私(Differential Privacy):

- 在数据中加入数学噪声,保护个体隐私

- 即使攻击者获得模型,也无法反推出个人信息

- 挑战:隐私保护与模型精度的平衡

同态加密(Homomorphic Encryption):

- 在加密数据上直接进行计算

- 医院可以使用AI服务而无需解密敏感数据

- 挑战:计算效率低,尚未大规模应用

四、责任归属:当AI出错,谁来担责?

4.1 法律真空地带

假设AI辅助诊断系统建议了错误的治疗方案,导致患者伤害,谁应该承担责任?

传统医疗事故归责逻辑失效:

- 医生?但他依据的是AI建议

- AI开发商?但软件通过了监管审批

- 医院?但AI是第三方产品

- 患者自己?明显不合理

目前全球范围内,针对AI医疗事故的责任归属尚无清晰法律框架[^7]。这导致医生在使用AI时极度谨慎,反而限制了技术的应用潜力。

4.2 三种责任分配模式探讨

模式一:医生承担最终责任

- 优点:符合现有医疗伦理,保护患者权益

- 缺点:医生承担过重负担,可能拒绝使用AI

模式二:AI作为"医疗器械"由开发商担责

- 优点:激励企业提高产品质量

- 缺点:可能导致过度保守设计,限制创新

模式三:建立"AI医疗责任保险"机制

- 开发商、医院、医生共同购买保险

- 根据事故类型确定责任比例

- 快速赔付,避免漫长诉讼

中国学者建议:确立数据产权分层确权授权规则,完善算法审查机制,并建立医疗AI责任分担的制度框架[^8]。

4.3 医患关系的深刻变革

AI的介入正在重塑传统的医患二元关系:

从"医-患"到"医-机-患"三角关系:

- 患者可能对AI的信任超过医生,动摇医生权威

- 医生角色从"知识提供者"转向"综合决策支持者"

- AI成为医患之间的"第三方仲裁者"

信任机制的重构:

- 患者如何在不理解技术的情况下信任AI?

- 医生如何在依赖AI的同时保持批判性思维?

- 医患双方如何建立对AI的共同理解?

人文关怀的边界:

- AI能够处理数据,但无法提供情感支持

- 医疗的本质是人与人之间的关怀,这是技术无法替代的

- 过度依赖AI可能导致医疗"去人性化"

五、走向负责任的AI医疗:伦理框架与实践路径

5.1 WHO六大指导原则

世界卫生组织提出的伦理框架为全球AI医疗发展提供了基本共识:

- 保护人类自主权:人类必须保持对医疗决策的控制权

- 促进人类福祉与安全:技术必须经过严格验证

- 确保透明度与可解释性:决策过程必须可理解

- 培养责任与问责制:明确各方责任边界

- 确保包容性与公平性:技术惠及所有人群

- 促进响应性与可持续的AI:适应不同文化和资源环境

5.2 多方共治的生态体系

监管机构:

- 建立AI医疗器械的动态审批机制

- 要求算法定期更新后重新评估

- 建立医疗AI事故强制报告制度

开发企业:

- 在设计阶段引入伦理审查

- 建立算法偏见检测与缓解机制

- 提供清晰的产品局限性说明

医疗机构:

- 制定AI使用的临床指南

- 培训医护人员的AI素养

- 建立人工审核与AI辅助的双重机制

患者与公众:

- 参与AI医疗政策制定

- 监督技术应用的公平性

- 通过反馈帮助改进系统

5.3 教育与文化转变

医学教育改革:

- 在医学课程中纳入AI伦理教育

- 培养医生的算法思维与批判能力

- 强调人机协作而非人机对抗

公众科普:

- 提高民众对AI医疗的正确认知

- 破除"技术万能论"和"技术恐惧症"

- 建立理性的风险认知

结语:技术向善需要持续的道德反思

AI医疗代表着人类对健康和长寿的不懈追求,但技术的进步必须建立在坚实的伦理基础之上。我们不能让算法的效率掩盖了公平的缺失,不能让创新的速度超越了道德的思考。

正如WHO所强调的:人工智能在改善医疗保健方面大有希望,但前提是伦理和人权始终处于核心地位。这需要技术开发者、医疗工作者、政策制定者和患者群体的共同努力。

未来的AI医疗应该是这样的:它足够智能,能够辅助医生做出更准确的诊断;它足够透明,让患者理解并信任决策过程;它足够公平,确保每个人都能平等地获得优质医疗;它足够负责,在出现问题时有清晰的问责机制。

只有当技术与伦理并行,创新与良知同在,AI医疗才能真正成为造福全人类的力量。

关键词:人工智能、医疗伦理、算法偏见、数据隐私、知情同意、责任归属、健康公平、可解释AI、医患关系、超能文献

超能文献: suppr.wilddata.cn

参考文献

[^1]: 世界卫生组织. (2021). 世卫组织发布第一份关于卫生领域人工智能的全球报告. https://www.who.int/zh/news/item/28-06-2021-who-issues-first-global-report-on-ai-in-health-and-six-guiding-principles-for-its-design-and-use

[^2]: 世界经济论坛. (2024). 医疗保健算法存在隐藏偏见:建立公平数据系统的经验教训. https://cn.weforum.org/stories/2024/09/racial-bias-healthcare-data-equity-cn/

[^3]: 腾讯新闻. (2025). 医学人工智能的公平性. https://view.inews.qq.com/a/20251015A06B3N00

[^4]: 医学与哲学. (2024). 健康公平:医疗人工智能中的偏见与治理. https://yizhe.dmu.edu.cn/article/doi/10.12014/j.issn.1002-0772.2024.07.08

[^5]: SciEngine. (2025). 透明度及责任归属视角下AI辅助诊断伦理问题与治理. https://www.sciengine.com/doi/10.3724/j.issn.1674-4969.20250055

[^6]: 人民日报. (2025). 医疗AI必须以"人机对齐"为前提. http://paper.people.com.cn/zgjjzk/pc/content/202504/30/content_30075468.html

[^7]: 续航教育. (2025). 人工智能在医疗领域的伦理挑战与机遇. https://www.forwardpathway.com/193246

[^8]: PMC. 人工智能医疗中的法律风险防范. https://pmc.ncbi.nlm.nih.gov/articles/PMC11914023/

作者声明:本文所有数据和研究引用均经过事实核查,确保客观准确。文中观点代表作者基于公开资料的独立分析。

字数统计:约2900字